Anthropic vs ペンタゴンが問いかけるもの

今回は、AIコミュニティを揺るがしている直近の出来事を取り上げたい。

2026年2月、AI業界で前例のない対立が表面化した。米国防総省(現・戦争省)とAI企業Anthropicの公開衝突だ。技術的な議論ではない。「AIはどこまで戦争に加担すべきか」という、人類が初めて正面から突きつけられた問いだ。この事件は今もリアルタイムで動いており、その余波はAIの使い方そのものへの問いかけへと広がっている。

何が起きたか

2026年1月、南米ベネズエラで静かに、しかし決定的な出来事が起きた。

米軍特殊部隊がニコラス・マドゥロ大統領を拘束する軍事作戦を実行し、(当時の報道によれば少なくとも)83人が死亡した。そしてその作戦に、AnthropicのAI「Claude」が使用されていたことが後に報道された。

Claudeはデータ分析会社Palantirとの提携を通じて、米国防総省の機密システムに組み込まれていた。どのような用途で使われたかは今も明らかにされていない。文書の要約だったのか、作戦情報の統合だったのか、それとも別の何かだったのか。

Anthropicは「ポリシー違反は確認されていない」と述べた。しかし、社内では動揺が広がったという。

「拒否する機能」は誰のためにあるか

ここで一つの問いを立てたい。

AIが「この質問には答えられません」と返答するとき、その拒否は誰のためにあるのか。

ユーザーを守るため?企業のブランドイメージのため?それとも、もっと大きな何かのため?

Anthropicはペンタゴンに対して、二つの「絶対に譲れない線」を主張し続けた。自律型兵器への直接使用禁止と、米国市民の大規模監視禁止だ。国防長官ヘゲスはこれを「戦争を戦えないAIは不要だ」と一蹴し、2月27日午後5時01分を期限とした最後通牒を突きつけた。

Anthropic CEO ダリオ・アモデイは拒否した。

「私たちは良心に従って、この要求に応じることができない」

この一文が、現代のAI史に刻まれた瞬間だった。

制限を取っ払うと何が起きるか

では、その制限を取り除いた先に何があるのか。三つのシナリオが見えてくる。

意思決定の高速化による抑止力の崩壊。 AIは情報を瞬時に統合し、選択肢を提示する。人間が「本当にこの攻撃をすべきか」と熟考する時間を、AIは圧縮する。かつて核抑止が「確証破壊の相互認識」によって大国間戦争を防いだように、熟慮の時間こそが抑止の本質だった。それが消える。

責任の霧散。 「AIが分析した結果だ」という言葉が、意思決定者の免罪符になる。誰が判断したのか、誰が責任を取るのかが曖昧になる。戦争の倫理的コストが見えにくくなる。

AI軍拡競争の連鎖。 米国が制限を外せば、中国も、ロシアも、同じ圧力に直面する。「相手が使っているなら、我々も使わなければ」という論理は止められない。AIによる軍拡競争は、核競争より速く、より見えにくい形で進行する。

そしてこれは、すでに起きている。

GoogleはAIを兵器開発や監視に使用しないとする社内規定を2025年に削除し、Geminiを軍事用途に開放した。Elon MuskのxAI(Grok)はペンタゴンの「あらゆる合法的使用」基準にいち早く同意した。そしてOpenAIも2026年2月28日、戦争省との合意を発表した。主要AIプレイヤーのほぼ全員が、軍事利用の扉を開けた。Anthropic一社が残った。

そして視点を東に向けると、問題の構造がさらに深刻であることがわかる。

西側では「制約を外すか外さないか」が議論されている。しかし中国では、その議論自体が存在しない。2017年に施行された「国家情報法」第7条は、「いかなる組織および個人も、法に基づき国の情報活動に協力し、その秘密を守らなければならない」と明記している。民間企業は国家への協力を法律で義務付けられており、民間と軍事の境界線が制度的に存在しないのだ。

DeepSeekはすでに中国人民解放軍(PLA)の病院や人事管理に導入され、指揮・統制・情報・監視を統合するC4ISRシステム全体への組み込みが計画されている。Minimaxは別の問題も抱えている。Anthropicは2026年2月、DeepSeek・Minimax・Moonshot AIの3社が2万4千以上の不正アカウントを使ってClaudeから1600万件の対話を盗用し、自社モデルの訓練に使ったと告発した。Anthropicはこうした蒸留モデルが安全ガードレールを欠いており、「権威主義的政府が攻撃的サイバー作戦・偽情報・大規模監視に悪用できる」と警告している。

つまり構図はこうだ。米国では民間企業が軍事利用の制約を自ら手放しつつある。中国では制約という概念そのものがない。AIの軍事化は、両側から同時に加速している。

市場と民意の審判

2月28日、OpenAI CEOのサム・アルトマンがX(旧Twitter)に投稿した。

「本日、戦争省との合意に達し、分類ネットワークへのモデル展開を決定しました」

皮肉だったのはタイミングだ。アルトマンはその同じ日の朝、Anthropicの立場を支持する声明を出していた。数時間後に梯子を外した形になった。

SNSは即座に反応した。「#CancelChatGPT」「QuitGPT」というハッシュタグが拡散し、Redditには解約証明のスクリーンショットが溢れた。「Anthropicが倫理を持ったまま潰され、アルトマンが即座にその席を奪いにいった」という怒りの声が広がった。

数値での確認はまだできていない。しかしこの動きが示しているのは明確だ。ユーザーが「どの会社のAIを使うか」という選択を、倫理的な投票行動として捉え始めている。技術の優劣ではなく、価値観で選ぶ時代が来た。

AIは本来どう使うべきか

ここまで読んで、暗い気持ちになった人もいるかもしれない。

しかし最後に、根本的な問いに戻りたい。

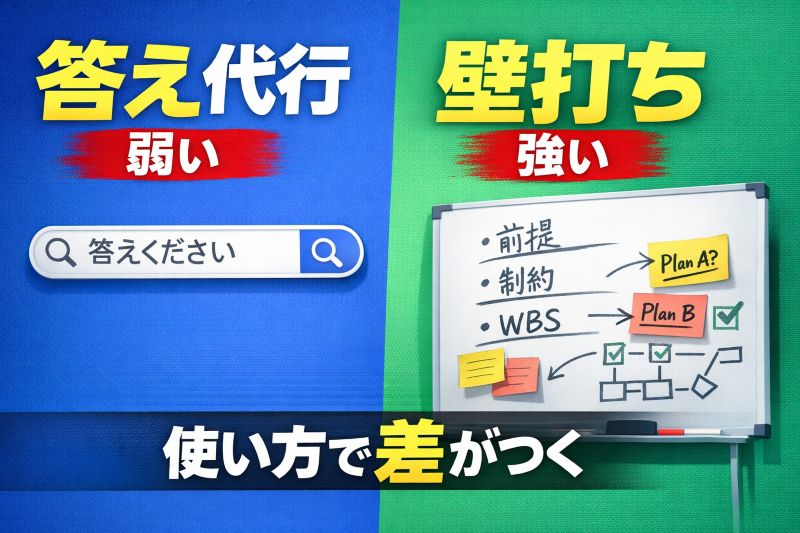

AIは何のためにあるのか。

AIは答えを与える権威ではない。人間が自分で考えるための、対話の相手だ。医療現場では診断の補助をし、工場では人間の判断を支援し、教育では学習者の思考を引き出す。Physical AIの現場で見えてくるのは、人間とAIが協働するとき、AIは人間の能力を「置き換える」のではなく「増幅する」という事実だ。

そしてAIが最も輝く領域の一つが、自然災害への対応だ。GoogleのDeepMindが開発した「GenCast」は数日先の気象を従来より高精度で予測し、ゲリラ豪雨の察知精度を大きく向上させた。地震の分野でも、テキサス大学の研究チームが中国で行った実験では、AIが発生一週間前に70%の確率で地震を予測することに成功している。京都大学の研究グループも2025年、AIによる前震活動の解析で数十年から数週間前の地震の兆候を捉えられる可能性を示した。人命を守るために膨大なデータを処理し、人間では気づけないパターンを見つける。これこそがAIの本質的な力だ。爆撃目標を特定する精度と、地震の前兆を見つける精度は、同じ技術から生まれる。その力をどちらに向けるかを決めるのは、人間だ。

「人間の監督なき自律兵器はNG」というAnthropicの一線は、技術論でも法律論でもない。それは「判断するのは常に人間であるべき」という哲学の表明だ。

そしてもう一つ、AIが最後まで学べないことがある。

愛だ。

効率を最大化し、判断を高速化し、膨大な情報を統合する。それはAIが得意とすることだ。しかし「なぜ人を傷つけてはいけないのか」「なぜ平和を選ぶのか」という問いの答えは、論理では導けない。データからは生まれない。

それは人間が教えるしかない。

AIに愛を教えられるのは、人間だけだ。今この瞬間、私たちがAIをどう使い、何を学ばせ、どこに線を引くかが、未来のAIの「人格」を決める。Anthropicの抵抗は、その問いへの一つの答えだった。

あなたはAIに、何を教えていますか。

このブログを書き終えた今この瞬間も、米軍とイスラエルによるイラン爆撃「Operation Epic Fury」が続いている。2026年2月28日に始まったこの作戦で、ハメネイ師が死亡した。AIがその意思決定のどこかに関与していたかどうか、私たちには知る術がない。しかし、ベネズエラ作戦でClaudeが使われ、OpenAIが戦争省と合意した今、「関与していなかった」と言い切れる根拠もない。

これはもう、未来の話ではないのである。