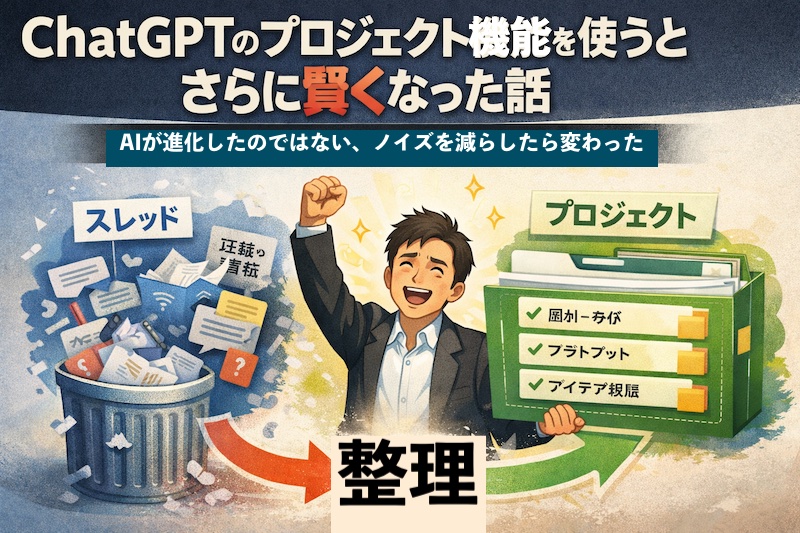

―― AIが進化したのではない。ノイズを減らしたら変わった

最近、ChatGPTの回答が

「なんだか一段、賢くなったな」と感じる瞬間があった。

論点を外さない。

前提を覚えている。

こちらの意図を汲んだ返しが返ってくる。

だが冷静に考えると、不思議だった。

自分はモデルを変えたわけでも、特別なプロンプトを仕込んだわけでもない。

変えたのは、ただ一つ。

ChatGPTの「使い方」だった。

スレッド運用に、ずっと感じていた違和感

これまでのChatGPTのスレッドの使い方は、典型的だったと思う。

- スレッドを立てて会話する

- 話が長くなる

- いずれ上限に近づく

- 引き継ぎ文を書く

- 新しいスレッドを立てる

これまで私はこの流れを何度も繰り返してきた。

スレッドの使い方やスレッドの引き継ぎ方法については

このブログでも紹介している。

しかし、スレッドを引き継ぐ中で感じていた違和感がある。

- 前に決めた前提が、少しずつズレる

- 話題が混ざると、回答が浅くなる

- 「それ、さっき言ったよな?」が増える

AIが悪いというより、

会話の置き場そのものが雑然としている感覚 があった。

人間でも、会議の議題が混ざれば思考は鈍る。

それはAIも同じだろう。

プロジェクト機能は「賢くする機能」ではない

そこで使い始めたのが、ChatGPTのプロジェクト機能だ。

今回はこのプロジェクト機能について紹介したい。

実は私は最初は正直プロジェクト機能は、こう思っていた。

「スレッドをまとめるための整理機能だろう」

だが実際に使ってみると、印象はまったく違った。

プロジェクト機能の本質は、

「このプロジェクト内では、このテーマだけを考える」

とAIに宣言する仕切り

だと感じている。

- スレッド:作業ログ、思考の途中経過

- プロジェクト:前提条件、目的、世界観

例えるなら、

- スレッドは「ノート」

- プロジェクトは「バインダー」

この違いが、想像以上に大きかった。

私が実際にやった整理

すでにいくつかプロジェクトを切って運用を開始している。

- ブログ × AI × 副業構想

- 自動売買・投資システム

- キャリアや長期戦略

そして各プロジェクトの中で、

目的別にスレッドを分ける ようにした。

- 設計・方針を考えるスレッド

- 実験・検証を回すスレッド

- アウトプット(記事・文章)用のスレッド

- アイデア保留・発散用のスレッド

重要なのは、

「話題」ではなく「思考モード」で分けたこと だ。

ちなみに、今あなたが読んでいるこの話題も、

私の中では

「ChatGPTのプロジェクト機能そのものの使い方を整理するためのメタなスレッド」

として切り分けている。

中身を作る場所と、

道具の使い方を考える場所を分けた というわけだ。

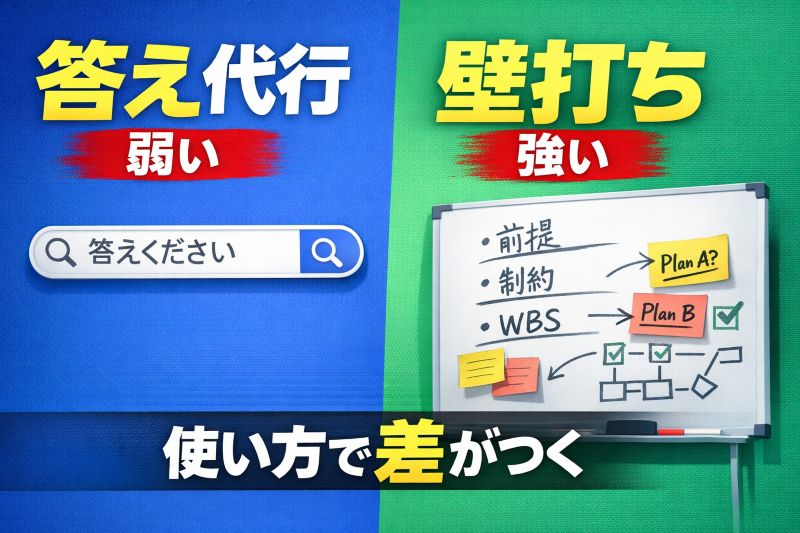

なぜChatGPTが賢くなったように感じたのか

ここが一番重要なポイントだ。

AIが進化したわけではない。

変わったのは、

- 入力される文脈の純度

- 話題の混線の少なさ

- 前提条件の安定性

つまり、余計なノイズが減った。

ChatGPTは、

賢さ以上に「集中できる環境」に影響される。

雑然としたスレッドでは、

それなりの答えしか返ってこない。

だが、

- 前提が固定され

- 目的が明確で

- 思考モードが混ざらない

この状態を作ると、

同じAIとは思えないほど推論が安定する。

これはプロンプトテクニック以前の話だ。

おすすめのシンプルな運用テンプレ

もしプロジェクト機能を使うなら、

最初から凝りすぎない方がいい。

プロジェクト

- 長期テーマごとに1つ

スレッド

- 設計・方針

- 実験・検証

- アウトプット

- アイデア保留

これだけで十分だ。

迷ったら、新しいスレッドは作らず

既存のスレッドに入れる。

溢れ始めたら分ける。

整理は「後追い」でいい。

AIは「使い方」より「環境」で変わる

ChatGPTを長く活用して、さらに筆者のように

複数のテーマに興味があり、多くのスレッドを使っていると、

どうしても

- メインテーマとは違う話が気になってスレッド内で質問したりする

- 複数スレッドで同じ話をしてしまい、同様トークのスレッドが点在する

といったことが起きてしまう。

だが今回の体験で、はっきりした。

AIは賢くするものではない。

考えやすい環境を与えるものだ。

整理された思考空間では、

AIは自然と「相棒らしく」振る舞い始める。

もし最近、

- 回答がブレる

- 話が噛み合わない

- 以前より浅く感じる

そう思っているなら、

プロンプトを疑う前に、

文脈の置き方 を疑ってみてほしい。

AIが変わったのではない。

こちらが整えただけだ。

それだけで、ChatGPTはもう一段、

頼れる存在になる。